Verfahren

Das implementierte Verfahren ordnet punktweise korrespondierende Bildausschnitte zu. Da korrespondierende Punkte anhand ihrer Lichtintensitäten ausfindig gemacht werden, liefert der Algorithmus nur bei diffus reflektierenden Objektoberflächen gute

Ergebnissse, die durch eine ausgeprägte Oberflächentextur noch optimiert werden können. Verdeckungen in der abgebildeten Szenerie, d.h. Regionen, die nur auf einem der beiden Teilbilder des Quellbilds abgebildet sind, können nicht korrekt zugeordnet

werden, da i.a. kein zusätzliches Wissen über die Szenerie verfügbar ist.

Das Verfahren basiert auf einem Ansatz von Yoshiaki Shirai (1987). Die Suche je zweier korrespondierender Punkte, die das Hauptproblem vor der eigentlichen Rekonstruktion darstellt, wird reduziert auf eine Zuordnung sämtlicher Punkte je zweier Epipolaren.

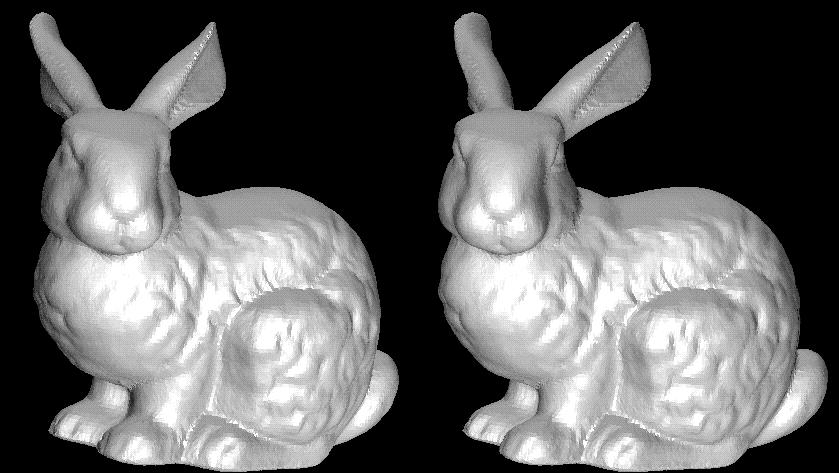

Mit computergeneriertem Testbildmaterial z.B. lassen sich zufriedenstellende Ergebnisse erzielen:

Ergebnissse, die durch eine ausgeprägte Oberflächentextur noch optimiert werden können. Verdeckungen in der abgebildeten Szenerie, d.h. Regionen, die nur auf einem der beiden Teilbilder des Quellbilds abgebildet sind, können nicht korrekt zugeordnet

werden, da i.a. kein zusätzliches Wissen über die Szenerie verfügbar ist.

Das Verfahren basiert auf einem Ansatz von Yoshiaki Shirai (1987). Die Suche je zweier korrespondierender Punkte, die das Hauptproblem vor der eigentlichen Rekonstruktion darstellt, wird reduziert auf eine Zuordnung sämtlicher Punkte je zweier Epipolaren.

Mit computergeneriertem Testbildmaterial z.B. lassen sich zufriedenstellende Ergebnisse erzielen:

Beispiele in Bildern

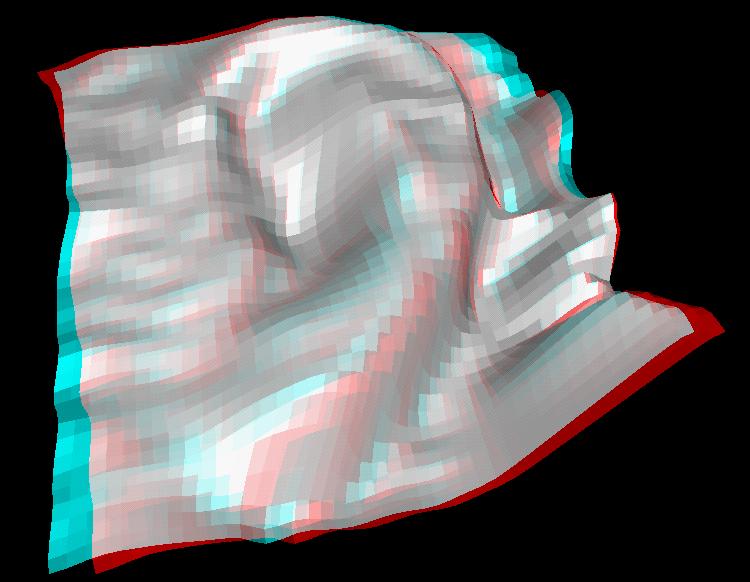

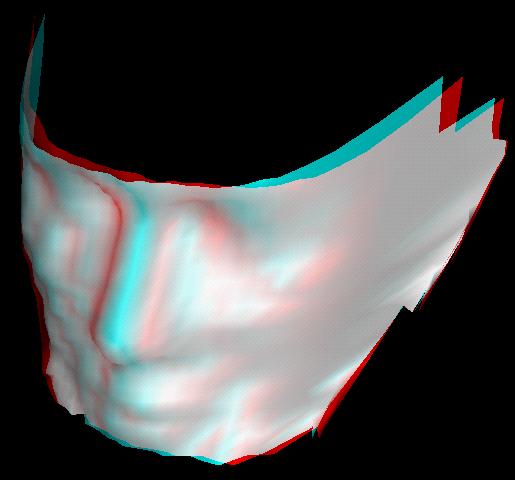

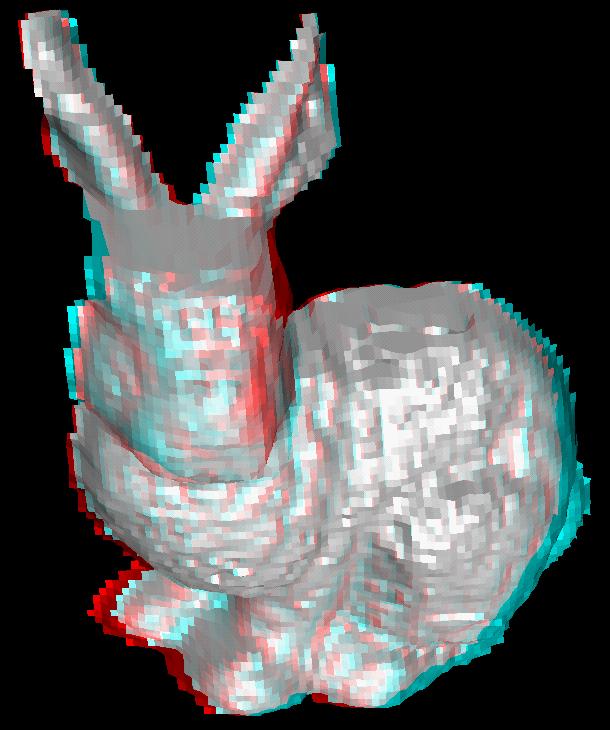

Die 3D-Bilder der rekonstruierten Objekte können mit einer rot/grün-Brille

betrachtet werden. Die besten Eindrücke sind dabei zu erzielen, wenn man sich

das ca. 4-fache der Kantenlänge des rot/grün-Bildes vor dem Monitor aufhält.

Alle Bilder können durch Anklicken vergrößert werden.

Alle Bilder können durch Anklicken vergrößert werden.

- Beispiel:

stereoskopisches Quellbild

(computergeneriert, je 86*88 Pixel)

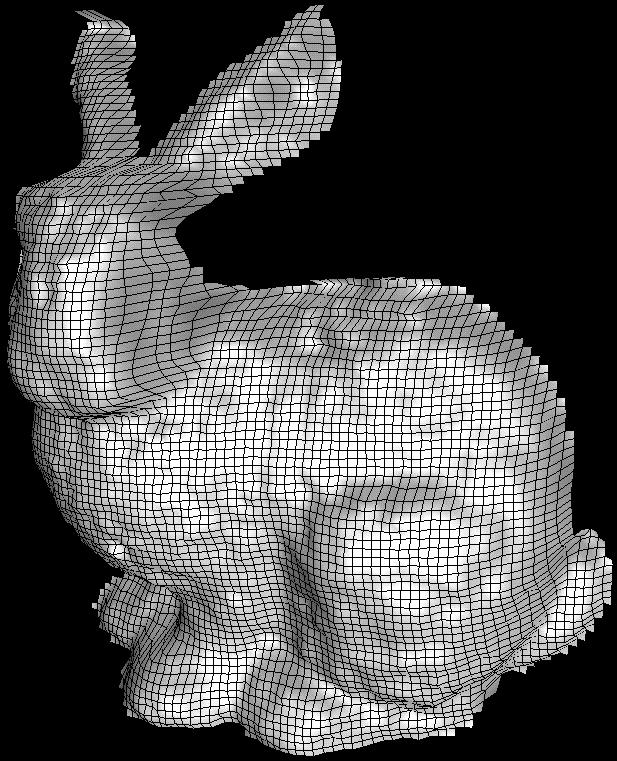

rekonstruiertes dreidimensionales Objekt

rekonstruiertes dreidimensionales Objekt

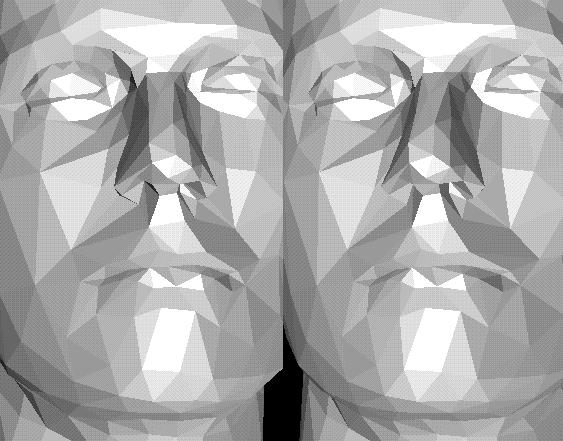

- Beispiel:

stereoskopisches Quellbild

(computergeneriert, je 252*366 Pixel)

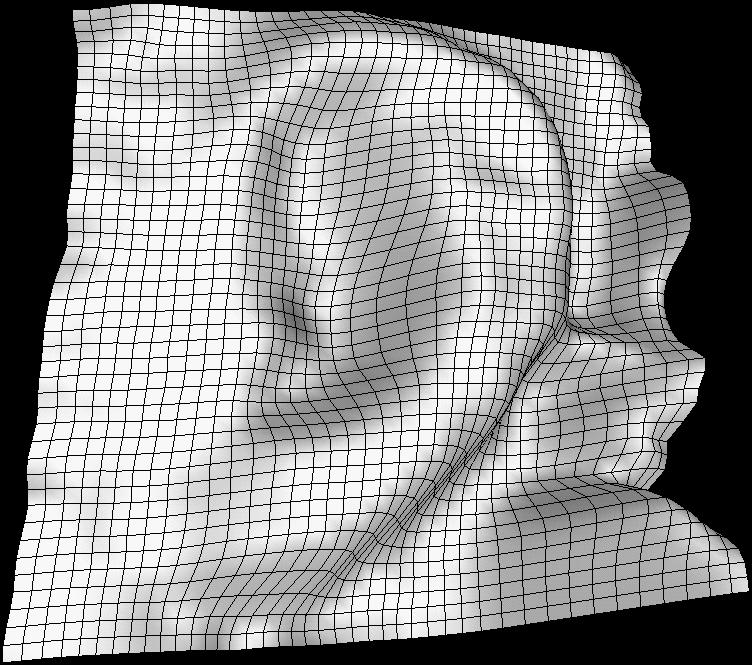

rekonstruiertes dreidimensionales Objekt

rekonstruiertes dreidimensionales Objekt

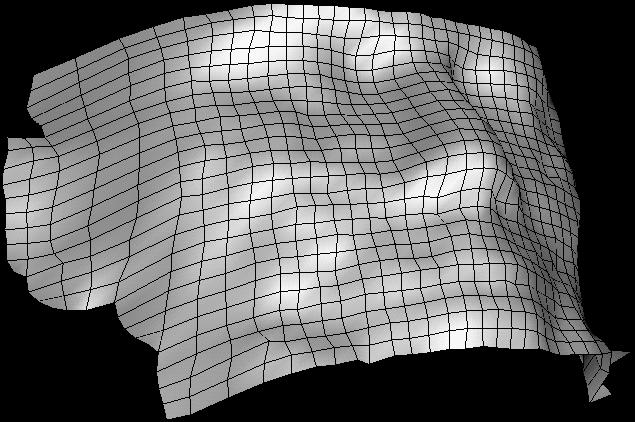

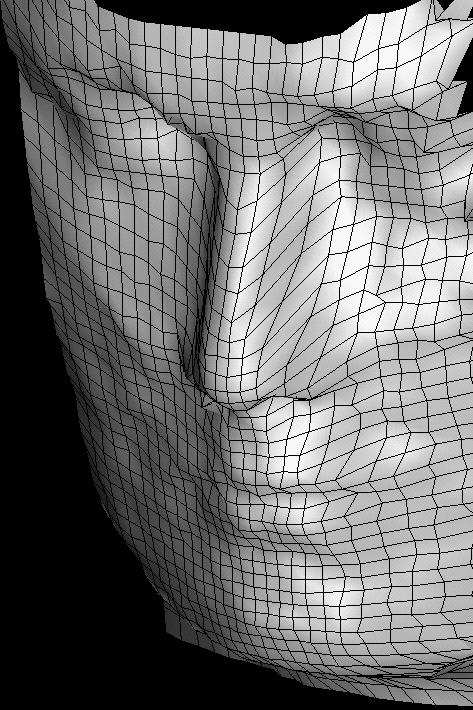

- Beispiel:

stereoskopisches Quellbild

(computergeneriert, je 256*441 Pixel)

rekonstruiertes dreidimensionales Objekt

rekonstruiertes dreidimensionales Objekt

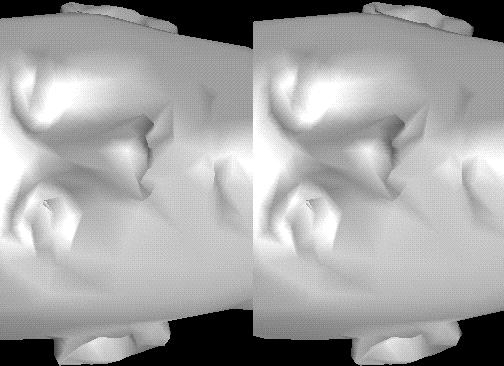

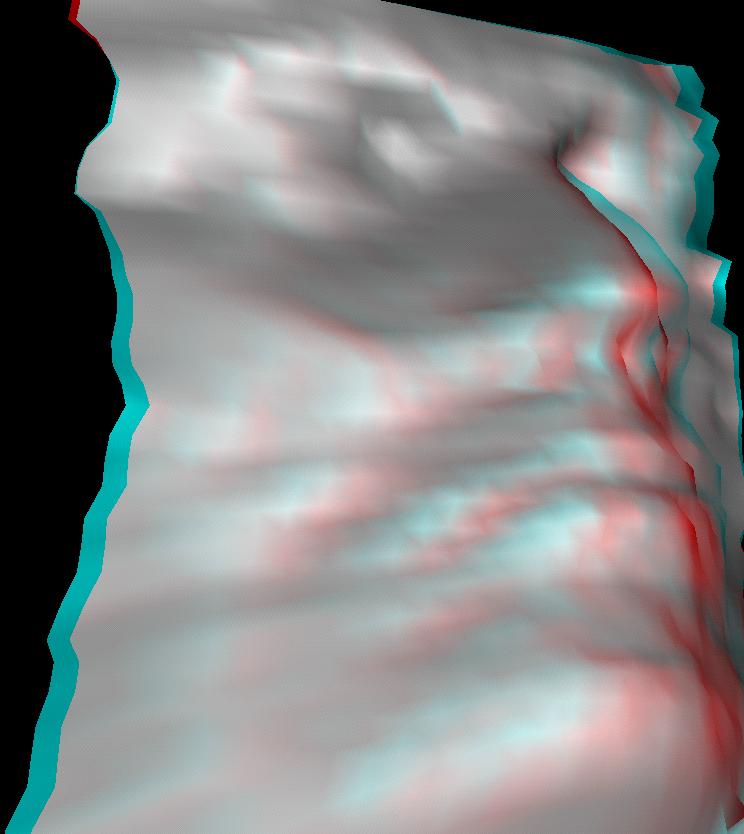

- Beispiel:

stereoskopisches Quellbild

(computergeneriert, je 419*473 Pixel)

rekonstruiertes dreidimensionales Objekt

rekonstruiertes dreidimensionales Objekt

(Nicht ganz optimale Farbfilterung ist hierbei auf die Lochmaske Ihres Monitors

zurückzuführen, wenn die Farbtöne von deren RGB-Komponenten nicht exakt

mit denen Ihrer Filterbrille übereinstimmen. Zusätzlich zu den rot/grün-Bildern

sind noch grün/rot-Bilder angegeben - je nachdem, wie Ihre Filterbrille beschaffen

ist; die grün/rot-Bilder sind allerdings durch Farbkomponentenvertauschung aus

den bereits komprimierten rot/grün Bildern entstanden und abermals komprimiert

worden, was die Komponententrennung bedauerlicherweise zusätzlich unschärfer

macht, da JPEG die Farbkomponenten unterschiedlich stark komprimiert ...)